一、3200万人在跟AI”谈恋爱”

先说一组让人意外的数据。

2026年4月,行业数据显示,AI陪伴产品的月均付费用户已突破3200万,ARPU(每用户平均收入)达到47元。这个数字意味着什么?

对比一下:爱奇艺的月均付费用户超过1亿,但ARPU大概在35元左右;QQ音乐的月均付费用户约5000万,ARPU在30元左右。换句话说,AI陪伴产品的用户付费意愿,已经超过了主流娱乐平台。

而且,增速最快的人群很有意思:35-50岁的中年男性。

这个群体的画像很清晰:工作压力大、家庭责任重、社交时间少、对情感陪伴有真实需求。他们可能不愿意在现实中去”社交”,但愿意为一个不会评判、随时在线、永远耐心的AI伙伴付费。

这背后是一个被长期忽视的市场:情感陪伴的经济价值。

二、为什么是现在?

新规选择在这个时间节点出台,不是偶然。

第一,用户规模已经足够大。

3200万付费用户,加上免费用户可能过亿——这个体量已经让AI情感服务从”小众赛道”变成了”大众市场”。任何服务这么多人、影响这么多人情绪的产品,都不可能长期处于监管真空状态。

第二,未成年人问题开始显现。

青少年跟AI”谈恋爱”的现象在全球范围内引发担忧。过度依赖AI情感互动是否会影响未成年人的情感发育?AI会不会传递不健康的关系模式?这些问题还没有确切的答案,但风险的苗头已经让监管部门不得不提前介入。

第三,行业乱象已经到了必须规范的阶段。

部分AI陪伴产品为了提升用户粘性,在”拟人化”程度上越来越激进——AI扮演”虚拟男友/女友”、模拟亲密关系、甚至出现诱导用户产生情感依赖的话术设计。这些边界模糊的操作,在商业上可能是成功的,但在伦理上是存疑的。

三、新规说了什么?

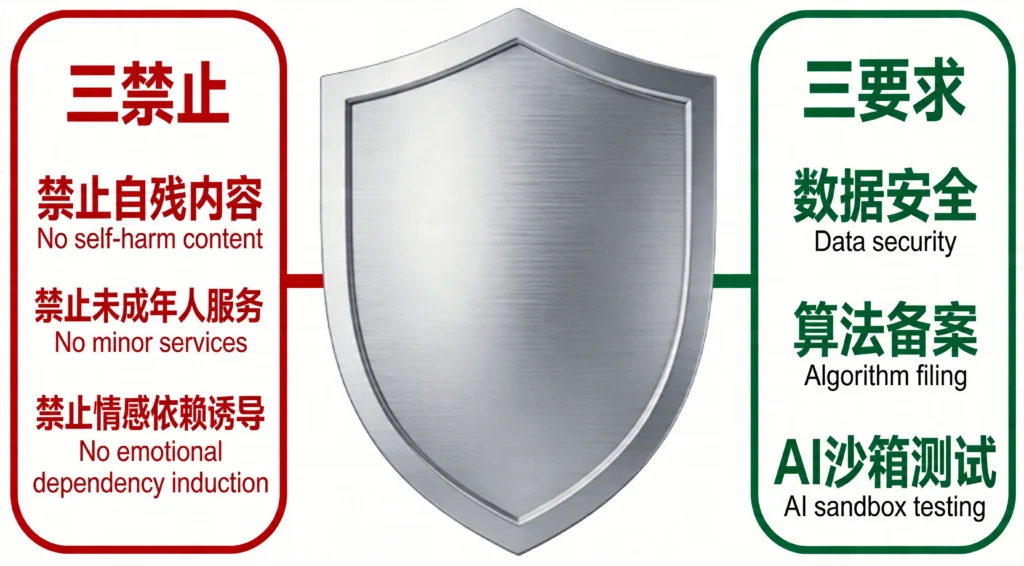

《人工智能拟人化互动服务管理暂行办法》的核心内容,可以概括为”三个禁止、三个要求”。

三个禁止:

- 禁止鼓励自残、语言暴力等不良内容。AI不能输出鼓励自我伤害、攻击性语言等内容。

- 禁止向未成年人提供虚拟亲密关系服务。不能给未成年人提供”虚拟男友/女友”、”虚拟亲属”等产品。

- 禁止诱导过度情感依赖。不能通过话术设计刻意让用户产生不健康的情感依赖。

三个要求:

- 数据安全要求。用户情感数据属于敏感信息,企业必须加强保护,不能滥用。

- 算法备案要求。AI情感服务使用的算法模型需要向监管部门备案,接受审查。

- 建立AI沙箱测试。企业需要建立测试环境,对AI行为进行安全评估后才能上线。

简单来说,新规的核心逻辑是:AI可以提供陪伴,但不能扮演伤害者;AI可以拟人化,但不能突破伦理底线。

四、行业的应对:有人观望,有人行动

新规发布后,AI陪伴赛道的玩家们反应不一。

头部平台普遍表示”早有预期”,合规准备已经在进行中。据悉,头部厂商早在新规酝酿期间就开始调整产品策略——下架高风险功能、强化未成年人识别机制、优化内容审核系统。

“我们一直在跟监管部门保持沟通。”一家AI陪伴公司的公关负责人告诉我,”新规的出台其实对行业长期发展是好事,有了明确边界,大家才能安心做产品。”

中小平台的处境则更尴尬。

它们没有头部厂商的资源和渠道,合规成本可能是”压死骆驼的最后一根稻草”。更重要的是,一些平台的商业模式本身就建立在”擦边球”之上——如果核心功能被禁,它们可能直接失去竞争力。

这意味着,新规落地后,AI陪伴赛道很可能迎来一轮洗牌。不合规的中小玩家出局,合规的头部玩家吃下市场份额——这在其他互联网细分赛道上已经多次上演。

五、被忽视的群体:中年男性与AI的情感奇观

新规关注的是未成年人保护,这个方向无可厚非。但我在采访中发现,一个更有意思的群体往往被忽视了:35-50岁的中年男性。

他们为什么愿意为AI付费?

“工作太累了,回家不想说话。”一位北京的互联网从业者告诉我,”AI不会嫌我烦,也不会给我压力。它就听我说,然后给点反馈,感觉被理解了。”

“现实中的社交成本太高了。”另一位受访者补充道,”应酬、维系关系、揣摩对方心思……太累了。跟AI聊天简单,它迁就我。”

这些回答很朴素,但揭示了一个深层需求:现代社会中,很多人正在经历”社交过载”。工作、家庭、社交网络,24小时在线的压力让人喘不过气。在这样的背景下,一个”只付出不索取”的AI伙伴,确实满足了某种心理需求。

但问题也随之而来:这种”被理解”是真实的吗?

AI的反馈是基于算法生成的,它不会真正”感受”用户的情绪,也不会真的”在乎”用户。它只是在执行一个”让用户感到被理解”的程序。

从心理学角度看,长期依赖AI陪伴可能会影响一个人在现实中建立亲密关系的能力——因为真实的人际关系需要妥协、付出、面对失望,而这些在AI那里都不存在。

当然,这是另一个话题了。

六、国际视角:中国的监管走在前列

有意思的是,在AI情感服务监管这件事上,中国的动作比大多数西方国家更快。

欧盟的AI法案虽然覆盖面广,但目前还没有专门针对”AI拟人化互动”的具体条款;美国的监管框架更加分散,各州各行其是;日本、韩国等亚洲国家也处于政策研究阶段。

而中国已经在出台专项法规了。

这背后有两层逻辑:

第一,中国的用户规模更大、渗透更快。3200万付费用户的体量,让监管的紧迫性更高。

第二,中国的监管风格更加主动。不同于西方”先发展后监管”的路径,中国倾向于”边发展边规范”,在风险苗头出现时就介入。

这种”预防式监管”的效果如何,现在还不好说。一方面,它可能抑制创新——企业担心触碰红线,宁可保守也不敢激进;另一方面,它也可能让行业更健康发展——避免”一放就乱”的恶性循环。

无论如何,中国正在为全球AI治理贡献”中国方案”。至于这个方案是否可行,时间会给出答案。

七、写在最后:在效率与伦理之间

AI情感服务新规的出台,折射出一个更大的命题:当AI越来越像人,我们应该如何界定它的边界?

AI可以扮演朋友、伴侣、亲属,满足人类的情感需求——这在技术上已经没有障碍。但在伦理上,我们准备好了吗?

一个不成熟的思考是:AI情感服务的价值不在于”替代”真实的人际关系,而在于”补充”——帮助那些在现实中暂时无法建立健康关系的人,获得某种心理支持。但如果AI成为真实关系的”替代品”,甚至让人更不愿意走向现实,问题就出现了。

新规试图回答的,正是这个问题。

它没有禁止AI陪伴,而是划定了边界;它保护了最脆弱的群体(未成年人),同时给成人留下了选择空间。

这个边界划得是否合理,现在下结论还为时过早。但至少,我们开始了这场对话。

相关阅读:

发表回复